学院资讯

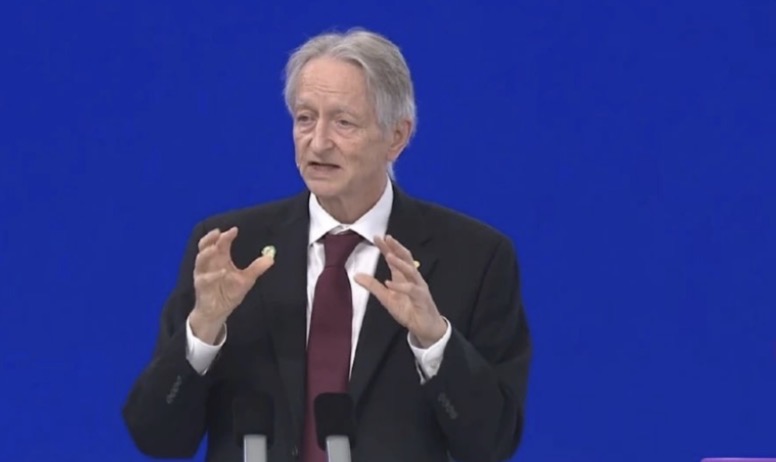

“ AI教父” Hinton出现在Waic中:AI说将寻求更多控

作者:365bet体育日期:2025/08/01 浏览:

7月26日,2025年世界人工智能会议(WAIC)在上海正式开幕。会议欢迎“ AI教父” - 诺贝尔奖和图灵奖得主Geoffrey Hinton的重量级演讲者。这是欣顿首次访问中国并发表讲话。现年77岁的辛顿(Sinton)长期以来因腰椎疾病而感到困扰,他的健康状况不佳,几乎没有飞行。 Google团队曾经邀请他访问英国参观DeepMind团队,专门预订了一架私人飞机并换了椅子。欣顿还参加了《 WAIC开放》的前一天,参加了第四次国际安全(IDAI),并与情报行业的20多个人工专家签署并发布了“上海国际AI Security On International International对话”。在他的最新演讲中,他讨论了“如果数字情报将被生物情报取代”,并讨论了可以带来的挑战,并潜在的AI响应s。在当前的AI系统具有独立研究和进化的潜力之前,Hinton多次在公开的信件和演讲中多次教授。欣顿(Hinton)教导说,在过去的60年中,有两种不同的范式和途径来发展AI的象征性逻辑Paradigs和基于生物学的游行。 1985年,欣顿创建了一个小型模型,试图结合这两种理论,以解释人们如何理解词汇。他说:“我认为今天的大语言模型来自我那时的迷你语言模型。” “他们使用多个单词作为输入并使用更多的神经元结构。由于青年需要处理大量模糊数字,它们在研究的特征之间也建立了更复杂的参与模式。但是,就像我制作的小型模型一样,大型语言模型的方式就像人类一样,就像人类一样 - 主要的逻辑就是将语言转化为特征,然后将这些功能包括在这些功能中。在谈论生物智能时,欣顿说,几乎所有专家都认为人们会创造比人更聪明的Al。 “人们曾经是最聪明的生物,很难想象AI超越了人们。”他说。 “我们创建的AI代理人将帮助我们完成任务,将来他们将寻求更多的控制来生存和实现目标。”在Waic中,Hinton将再次发生他的经典隐喻,说:“人们就像抚养年轻的老虎小熊。除非您确定他们长大后不会伤害您,否则您应该担心。”欣顿认为这项努力应该是普遍的。但是他承认,各国不会与AI的危险用途合作,他希望与“防止世界在世界上盛行”以防止人工智能控制人民的控制权达成协议。 “人们应该建立一个国际安全机构的国际社会,并学习并培训AI的好。他说。欣顿建议这些国家能够负担得起国家主权境内的研究和共享结果,或者AI领导着建立关联的网络,以学习如何培训AI来帮助人们帮助人们而不是摧毁人们或领导人们。在2012年,Hinton团队开发的算法在2012年进行了算法,该算法称为卷积神经网络(CNN),这是一个非常高的频率,在人工智能领域和机器学习的重要分支中, GPU引起了Alexnet的完整学术和学术轰动也是计算机科学史上最具影响力的角色之一。近年来,Hinton研究的重点已逐渐改变为AI安全问题。他认为,人工智能发展的速度已经超出了预期,其潜力和风险不容忽视。 2023年,在欣顿(Hinton)离开Google之后,他经常讲话以表达对通用人工智能(AAGI)未来影响的担忧。他此前曾估计,服用AI和破坏人类文明的可能性在10%至20%之间,并呼吁技术和政府公司在AI安全研究中投资更多资源。他建议,至少有三分之一的计算资源将用于研究系统如何确保AI不会偏离人类的意图。他还批评了几家大型科技公司游说在追求商业利益的情况下放松管制,认为这是一个非常危险的趋势。

7月26日,2025年世界人工智能会议(WAIC)在上海正式开幕。会议欢迎“ AI教父” - 诺贝尔奖和图灵奖得主Geoffrey Hinton的重量级演讲者。这是欣顿首次访问中国并发表讲话。现年77岁的辛顿(Sinton)长期以来因腰椎疾病而感到困扰,他的健康状况不佳,几乎没有飞行。 Google团队曾经邀请他访问英国参观DeepMind团队,专门预订了一架私人飞机并换了椅子。欣顿还参加了《 WAIC开放》的前一天,参加了第四次国际安全(IDAI),并与情报行业的20多个人工专家签署并发布了“上海国际AI Security On International International对话”。在他的最新演讲中,他讨论了“如果数字情报将被生物情报取代”,并讨论了可以带来的挑战,并潜在的AI响应s。在当前的AI系统具有独立研究和进化的潜力之前,Hinton多次在公开的信件和演讲中多次教授。欣顿(Hinton)教导说,在过去的60年中,有两种不同的范式和途径来发展AI的象征性逻辑Paradigs和基于生物学的游行。 1985年,欣顿创建了一个小型模型,试图结合这两种理论,以解释人们如何理解词汇。他说:“我认为今天的大语言模型来自我那时的迷你语言模型。” “他们使用多个单词作为输入并使用更多的神经元结构。由于青年需要处理大量模糊数字,它们在研究的特征之间也建立了更复杂的参与模式。但是,就像我制作的小型模型一样,大型语言模型的方式就像人类一样,就像人类一样 - 主要的逻辑就是将语言转化为特征,然后将这些功能包括在这些功能中。在谈论生物智能时,欣顿说,几乎所有专家都认为人们会创造比人更聪明的Al。 “人们曾经是最聪明的生物,很难想象AI超越了人们。”他说。 “我们创建的AI代理人将帮助我们完成任务,将来他们将寻求更多的控制来生存和实现目标。”在Waic中,Hinton将再次发生他的经典隐喻,说:“人们就像抚养年轻的老虎小熊。除非您确定他们长大后不会伤害您,否则您应该担心。”欣顿认为这项努力应该是普遍的。但是他承认,各国不会与AI的危险用途合作,他希望与“防止世界在世界上盛行”以防止人工智能控制人民的控制权达成协议。 “人们应该建立一个国际安全机构的国际社会,并学习并培训AI的好。他说。欣顿建议这些国家能够负担得起国家主权境内的研究和共享结果,或者AI领导着建立关联的网络,以学习如何培训AI来帮助人们帮助人们而不是摧毁人们或领导人们。在2012年,Hinton团队开发的算法在2012年进行了算法,该算法称为卷积神经网络(CNN),这是一个非常高的频率,在人工智能领域和机器学习的重要分支中, GPU引起了Alexnet的完整学术和学术轰动也是计算机科学史上最具影响力的角色之一。近年来,Hinton研究的重点已逐渐改变为AI安全问题。他认为,人工智能发展的速度已经超出了预期,其潜力和风险不容忽视。 2023年,在欣顿(Hinton)离开Google之后,他经常讲话以表达对通用人工智能(AAGI)未来影响的担忧。他此前曾估计,服用AI和破坏人类文明的可能性在10%至20%之间,并呼吁技术和政府公司在AI安全研究中投资更多资源。他建议,至少有三分之一的计算资源将用于研究系统如何确保AI不会偏离人类的意图。他还批评了几家大型科技公司游说在追求商业利益的情况下放松管制,认为这是一个非常危险的趋势。 上一篇:马斯克对特斯拉的全球销售销售做出回应:公司

下一篇:没有了

下一篇:没有了

相关文章

- 2025-08-01“ AI教父” Hinton出现在Waic中:AI说将寻求

- 2025-08-01江宫就像一个梦想:武术和心理技术的完

- 2025-07-31马斯克对特斯拉的全球销售销售做出回应

- 2025-07-31什么是以团队为中心的游戏?跑步流行游

- 2025-07-29KA H3咖啡机Tmall促销,价格为4,929元